明天开工,总结下这个春节 AI 圈的几个趋势:

这个春节,AI 圈基本没放假。

我在新加坡过年的这几天,一边带孩子,一边手机上 智能分身 OpenClaw 不断弹出各种消息:GLM-5 上了、MiniMax M2.5 开源了、豆包上春晚了、千问请全国人民喝奶茶了、元宝直接发了 10 亿红包。

核心结论:代码继续贬值,入口和验证继续升值。谁能把"流量"转成"可复用工程能力",谁就赢下下一阶段。

如果你时间不多,先看 3 句:

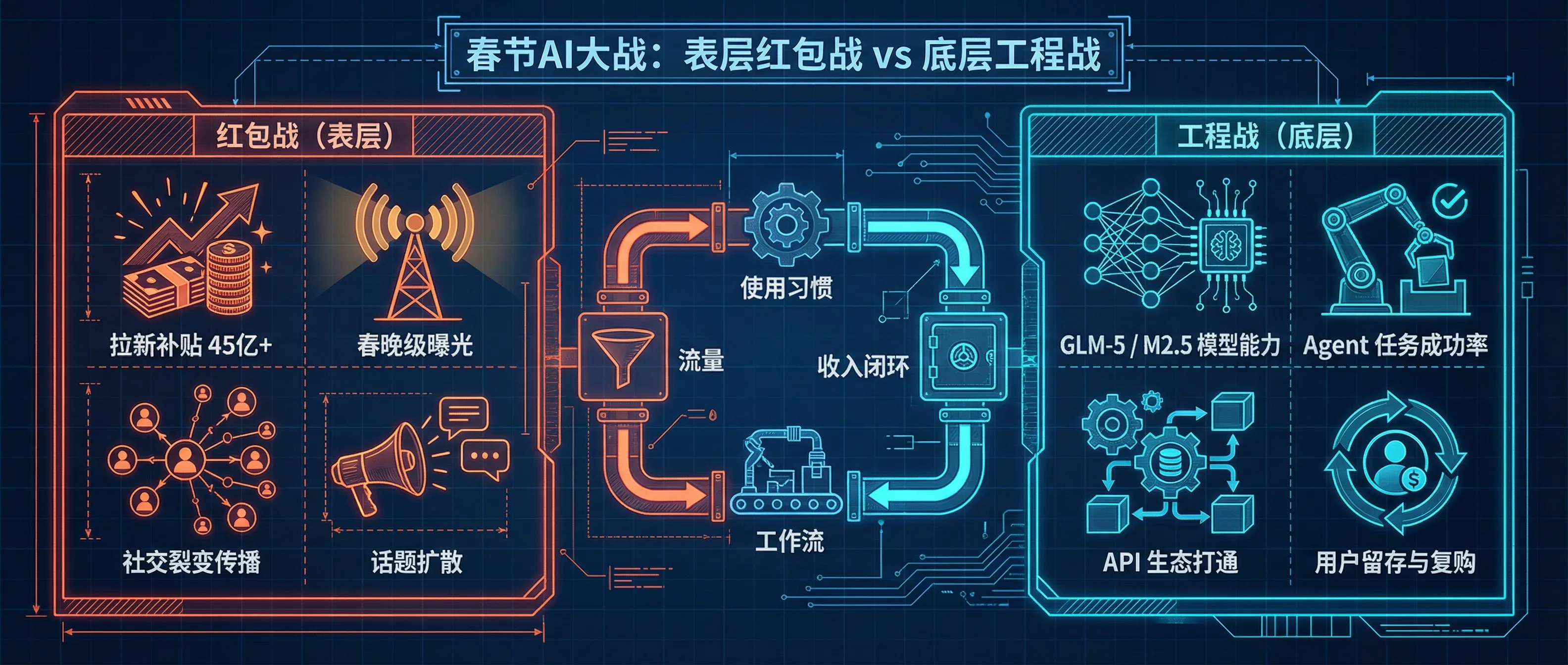

- 春节这波不是单纯”发红包”,而是 AI 入口争夺战——总投入超 45 亿,核心战场不在红包金额,而在谁先占住你手机上那个”有事先问 AI”的入口。

- 真正的胜负手不是活动预算,而是模型能力能否沉淀到工作流。GLM-5 和 MiniMax M2.5 同一周上线,信号很明确:模型能力是留存根基。

- 对程序员来说,开工第一天要改的不是工具,而是交付定义——你的价值不再由”写了多少行代码”衡量。

一、春节发生了什么:先看事实,再谈判断

我先把公开、可核对的信息摆出来。这些数据来自各家官网、官方微博和公开报道,我尽量标注了来源。

1.1 模型端:两大旗舰同一周上线

| 时间 | 模型 | 关键参数 | 核心信号 |

|---|---|---|---|

| 2026-02-11 | GLM-5(智谱 Z.AI) | MoE 架构,7440 亿总参,400 亿激活,200K 上下文 | 国产昇腾芯片全链路训练,SWE-Bench Verified 开源 SOTA |

| 2026-02-12 | MiniMax M2.5 | MoE 架构,2300 亿总参,100 亿激活,100+ Token/s | Agent 生产级定位,SWE-Bench Verified 80.2%,次日全球开源 |

| 春节前后 | 通义 Qwen3-Coder-Plus / Wan2.6 | 多模型矩阵更新 | 模型能力与消费端入口并行推进 |

值得单独说一下:GLM-5 和 MiniMax M2.5 几乎是同一周发布的。 这不是巧合——春节期间发模型,就是要在”全民关注 AI”的窗口期抢叙事权。

GLM-5 的核心叙事很清楚:从”Vibe Coding”转向”Agentic Engineering”。智谱把这个词写在了技术报告的标题页上,意思是:AI 不再只是辅助你写代码,而是作为自主 Agent 参与工程全流程。它的另一个重要信号是”全链路国产芯片训练”——用华为昇腾完成了从预训练到对齐的全部过程,这在地缘政治层面有特殊意义。

MiniMax M2.5 的打法不同:它不追参数规模,而是追”可用性”。2300 亿参数但只激活 100 亿,意味着推理速度极快、成本极低。上线不到一天,全球用户就在 MiniMax Agent 上构建了 1 万多个专家。这个数据说明:速度和成本优势可以直接转化为用户活跃度。

1.2 入口端:红包不是红包,是”请你先用一次 AI”

这场红包大战的投入总额据报道超过 45 亿人民币。但如果你只看金额,就低估了这件事。

| 玩家 | 春节动作 | 关键数据 | 我认为的信号 |

|---|---|---|---|

| 豆包(字节跳动) | 春晚独家 AI 合作伙伴,送科技好礼+最高 8888 元红包 | 除夕 AI 互动 19 亿次,周活 1.55 亿 | 用春晚级流量做用户教育 |

| 千问(阿里) | “30 亿春节请客计划”,免单券+请喝奶茶 | 连续多日 App Store 免费榜第一 | 串联淘宝/飞猪/盒马,做”有事找 AI”的消费心智 |

| 元宝(腾讯) | 直接派发 10 亿现金红包,单个最高 1 万元 | DAU 超 5000 万,MAU 达 1.14 亿 | 复制当年微信红包路径,社交裂变拉新 |

先说明一个边界:关于各家的具体投入金额,不同媒体口径不完全一致(有说总计 45 亿的,也有说 80 亿的),本文以各方相对一致的数据为准。

但金额不是重点。重点是三件事:

-

豆包拿到的是”春晚级入口”。春晚的覆盖力不需要解释,字节用这个入口让几亿人第一次在节日场景里和 AI 互动——不是搜索,不是问答,是”发红包+做头像+写祝福”这种全民可参与的场景。除夕当天 AI 互动 19 亿次、生成了 5000 万张头像,这组数据说明消费端的 AI 使用习惯正在被高速建立。

-

千问串的是”电商+生活服务”链路。它不只是”请你喝奶茶”,而是把千问和淘宝闪购、飞猪、盒马等阿里系业务接在一起——你在千问里领券、点餐、下单,数据全部回流到阿里生态。这是把”AI 助手”做成”消费入口”的典型打法。

-

元宝走的是”社交裂变”老路。腾讯高层明说要”重现微信红包当年的成功”。结合微信和 QQ 生态做分享裂变,用最简单的”发红包-抢红包”机制让用户打开元宝 App。

二、为什么我说这不是”红包大战”,而是”入口重构战”

很多人把这波看成”节日营销”。我觉得只看到了表层。

表层是红包,底层是三件事:

- 入口重排:谁先占据用户手机上那个”遇到问题先打开”的 App 位置,谁就先拿到交互数据和使用习惯。

- 心智重排:用户正在从”AI 是搜索替代品”升级到”AI 是事务代理人”——不只是查信息,而是帮我做事、帮我下单、帮我写东西。

- 工作流重排:企业端开始把模型能力嵌入真实业务链路。你今天看到的”请喝奶茶”背后,是千问和淘宝下单系统的 API 打通;你看到的”春晚互动”背后,是豆包大模型的实时推理集群在承压。

换句话说:红包是”开门动作”,模型和工程才是”复利动作”。

举一个具体例子。千问这次”请喝奶茶”活动,你领到一张 25 元免单券之后,实际下单路径是:千问 → 淘宝闪购 → 商户 → 配送。整条链路跑通意味着千问不再只是一个”对话框”,而是一个可以触发真实交易的入口。如果这个入口能留住用户,阿里就获得了一个新的流量分发通道。

同样,豆包在春晚场景里做”AI 头像生成”“AI 祝福生成”,本质上是在教育用户一件事:你的手机上有一个 AI App 可以帮你做有趣的事。 当这个习惯建立起来,后续的商业化场景(写作辅助、图片生成、视频创作)才有根基。

三、模型端的真正角力:不是”谁更大”,而是”谁更能用”

回到模型层面。我想更深入地比较一下 GLM-5 和 MiniMax M2.5,因为它们代表了当前中国 AI 模型竞争的两条典型路线。

3.1 GLM-5:昇腾芯片 + 全参数规模 + Agentic Engineering

GLM-5 的技术报告里有几个我特别关注的点:

- 7440 亿总参数,推理激活 400-440 亿。这个规模在开源模型里处于头部。

- 200K 上下文窗口,集成了 DeepSeek Sparse Attention(DSA),在保持长上下文能力的同时控制推理成本。

- 全链路华为昇腾芯片训练。之前的大模型训练几乎都依赖 NVIDIA GPU,这次标明”All-Ascend Pre-training”,是技术自主性上的重要信号。

- SWE-Bench Verified 达到开源 SOTA,在真实编程场景中的使用体验,官方说法是”接近 Claude Opus 4.5”。

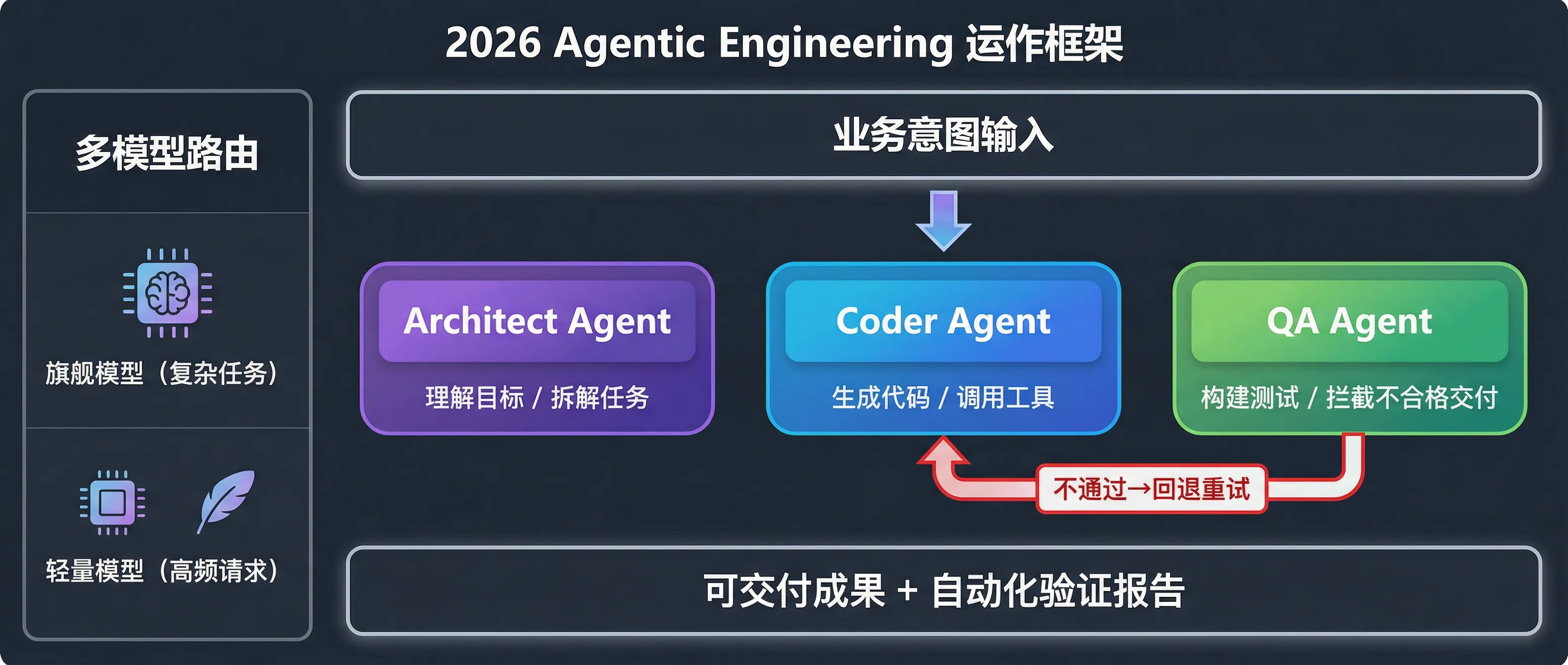

智谱用了一个很有意思的定位词:”从 Vibe Coding 到 Agentic Engineering”——也就是说,AI 不应该只是”帮你快速出代码”(Vibe Coding),而应该作为工程团队中的自主角色,理解任务、拆解需求、自动执行并自我验证。

3.2 MiniMax M2.5:极致效率 + 开源即可用

MiniMax M2.5 走的完全是另一条路:

- 2300 亿总参数,但推理只激活 100 亿。这意味着大幅降低了部署门槛和推理成本。

- 输出速度 100+ Token/s,是主流模型的 2 倍左右。在 Agent 场景里,速度就是体验。

- 输入价格约 $0.3/百万 Token,输出约 $2.4/百万 Token。这个成本在复杂 Agent 应用中非常有竞争力。

- SWE-Bench Verified 得分 80.2%,在 Multi-SWE-Bench 等多语言复杂环境中超越了 Opus 4.6。

- 次日全球开源。从发布到开源不到 24 小时,上线不到一天就有 1 万多个专家被构建。

两条路线的差异很清楚:

GLM-5 赌的是”绝对能力”——参数够大、能力够强,能承接最复杂的 Agent 任务和长程工程链路。它的隐含假设是:未来的 Agent 需要足够强的底层模型来理解复杂意图。

MiniMax M2.5 赌的是”可用性”——模型要快、要便宜、要能立即部署。它的隐含假设是:用户和开发者更在意”用起来的感觉”,而不是纸面参数。

我的判断是:两条路都对,但赢面在谁先跑通”模型→Agent→工作流→收入”这条闭环。 参数大但用不起来是浪费,效率高但能力不够也撑不住复杂场景。胜负手在后面几个月的落地数据。

四、这和软件工程有什么关系:关系非常大

如果你还把 AI 当”写代码插件”,那你会低估这次变化。

以前的 AI Coding 是什么?是 Copilot、是自动补全、是”你写一半它帮你补一半”——本质上,程序员还是主角,AI 是配角。

现在的 Agentic Engineering 是什么?是 Agent 自己理解需求、拆解任务、生成代码、跑测试、提交 PR、发现问题再回退重试——程序员的角色正在从”实现者”变成”编排者 + 审核者”。

对工程团队来说,真正变化有四层:

- 需求层:用户期待”直接给结果”,不是”给建议”。千问帮你下单、豆包帮你生成头像——用户不想看中间过程,只要最终结果。

- 架构层:单模型策略正在变成多模型路由策略。旗舰模型处理复杂任务,轻量模型处理高频简单请求,成本和体验两头都要。

- 质量层:人工 review 比例下降,自动化验证权重上升。Anthropic 的数据显示,虽然约 60% 的工作中已使用 AI,但完全委托给 AI 的任务比例仍在 0-20%,说明人类监督仍然是关键。

- 组织层:团队里需要新角色——Agent 编排师、Prompt 工程师、AI QA 专家。传统的”产品 → 开发 → 测试”三段式交付正在被重构。

代码不再是资产,意图与测试才是资产。

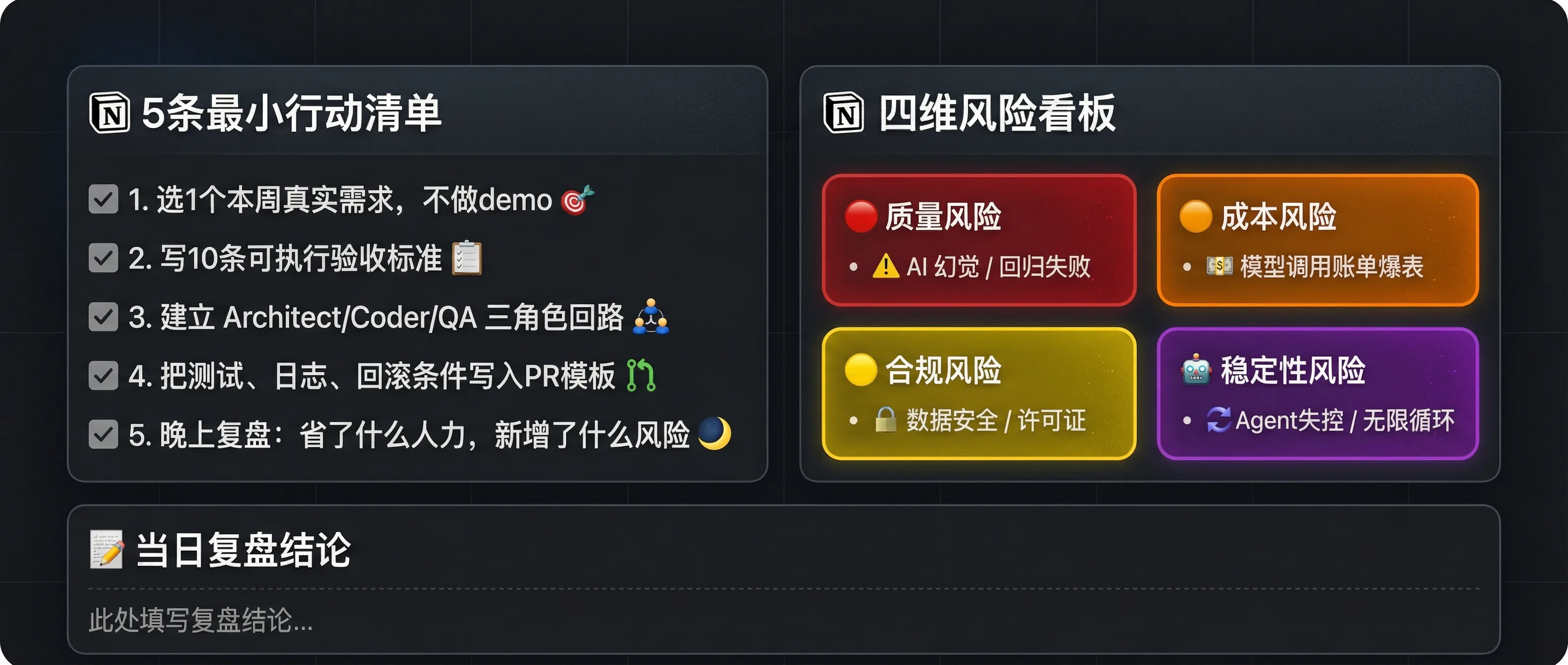

五、开工第一天,你必须先搞明白的 5 件事

5.1 先改 KPI:代码不是最终交付物

从今天起,团队应该用三件事衡量产出:

- 意图是否清晰(需求边界是否明确)

- 验证是否完备(测试与验收是否可执行)

- 结果是否可追责(失败能否定位到环节)

如果你的团队还在用”代码行数”或”PR 数量”作为核心指标,那今天就是改的时候。

5.2 把 AI 当”团队”,不是”对话框”

最小可用的 Agent Team 依然是这三角:

- Architect Agent:理解业务目标、拆解任务、定义接口。

- Coder Agent:实现代码、调用工具、迭代提交。

- QA Agent:构建测试、执行回归、拦截不合格交付。

GLM-5 和 MiniMax M2.5 都在朝”Agentic”方向走,说明这三角色协同不是概念,而是正在成为模型能力的一部分。

5.3 立硬规则:先验收,再生成

至少把这 4 条写进团队模板:

- 先写验收标准,再让 Agent 编码。

- 每次生成必须跑自动化测试。

- 不满足阈值(质量/性能/安全)不得合并。

- 失败路径要可回滚、可复现、可复盘。

5.4 护城河已换代:重点补四个能力

- 系统设计能力——AI 能写代码,但不知道该写什么架构。

- 测试驱动能力——你定义验收标准的能力决定了 AI 产出的质量上限。

- 多 Agent 编排能力——如何让多个 Agent 协同而不互相冲突。

- Prompt + Skill Engineering——把经验沉淀成可复用、可传递的”技能定义”。

5.5 立即执行:第一天最小行动清单

- 选 1 个本周真实需求,不做 demo。

- 写 10 条可执行验收标准。

- 建立 Architect/Coder/QA 三角色回路。

- 把测试、日志、回滚条件写入 PR 模板。

- 晚上复盘:省了什么人力,新增了什么风险。

六、往远看一步:这波之后的 3 个趋势

春节这一波只是开始。往前看,我认为有三件事会在 2026 年持续发酵:

6.1 多 Agent 并行将成为标配

现在的 AI Coding 工具大多还是”一个 Agent 一个任务”。但 GLM-5 的 200K 上下文窗口和 MiniMax M2.5 的极致推理速度,都在为”多 Agent 同时工作”铺路。Gartner 预测 2026 年 AI 智能体将实现数周级的任务连贯性。这意味着未来你可能同时有 5 个 Agent 在不同分支上并行开发,你的工作是审查和合并。

6.2 “入口→工作流→收入”的闭环竞争才刚开始

春节红包解决了”让用户打开 App”的问题,但后面还有两道坎:让用户留下来(工作流价值),让用户付费(收入转化)。这两道坎才是真正的竞争壁垒。

6.3 程序员的”升值方向”更清楚了

不是”学更多语言”,不是”刷更多 LeetCode”。而是:

- 能设计出让 Agent 高效执行的系统架构

- 能定义出让 AI 产出可验证的验收标准

- 能编排多 Agent 协同而不翻车

- 能把经验沉淀成可复用的 Skill 和 Prompt

升值的不是”写代码的手速”,而是”定义问题的精度”。

写在最后

今年春节让我最确定的一件事是:

不是”AI 要不要进主流程”,而是”AI 已经进主流程,谁还没完成组织升级”。

GLM-5 和 MiniMax M2.5 在同一周发布,不是模型公司在”卷参数”,而是在”抢定义权”——谁先定义了 Agentic Engineering 的标准工作流,谁就拿到了下一代软件工程的话语权。

豆包、千问、元宝撒了几十亿的红包,不是在”烧钱拉新”,而是在”抢入口”——当用户习惯了”有事先问 AI”,后面的商业化链路就顺了。

所以开工第一天真正要搞明白的,不是”我该选哪家模型”,而是:

我的团队有没有准备好从”写代码”转向”编排 Agent”。

如果还没有,从今天的那 5 条行动清单开始。

参考资料(官网/官方)

- Z.AI Release Notes:New Released(含 2026-02-11 GLM-5)

https://docs.z.ai/release-notes/new-released - Z.AI Docs:GLM-5 Overview

https://docs.z.ai/guides/llm/glm-5 - 智谱 AI 官方:GLM-5 技术报告(All-Ascend Pre-training、Agentic Engineering 定位)

https://zhipuai.cn/ - MiniMax API Docs:Models Release Notes(含 Feb. 2026 M2.5 发布)

https://platform.minimax.io/docs/release-notes/models - MiniMax API Docs:Text Generation(M2.5 能力与效率指标)

https://platform.minimax.io/docs/guides/text-generation - MiniMax M2.5 Hugging Face 开源页面

https://huggingface.co/MiniMaxAI - 通义官网(Qwen / Wan 能力入口)

https://qianwen.aliyun.com/ - 豆包 × 2026 央视春晚独家 AI 云合作伙伴

https://research.doubao.com/ - 腾讯元宝春节红包活动(官方微博)

https://www.weibo.com/7914117279/QrLY7xX5i - 阿里千问”30 亿春节请客计划”

https://qianwen.aliyun.com/ - 界面新闻:2026 春节 AI 红包大战综合报道

https://www.jiemian.com/ - Anthropic:Agentic Coding Trends 2026(AI 使用比例与人类监督数据)

https://www.anthropic.com/