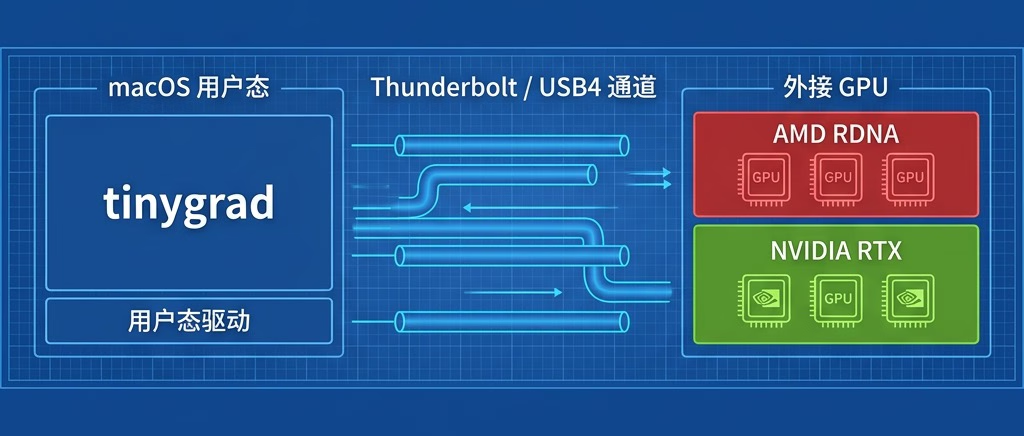

如果你手边有一块闲置的 AMD 或 NVIDIA 显卡,再加一台有 Thunderbolt 或 USB4 接口的 Mac——今天,你等了五年的日子来了。

社区终于把 Mac 外接显卡的驱动做通了。不是虚拟机,不是 Bootcamp,是实打实在 macOS 上用一根 Thunderbolt 线接上显卡,跑 AI 推理。

苹果没有官宣,但事实上放行了——用户态驱动不触碰内核,不需要关闭 SIP,一根线、一条命令,外接显卡就能工作。这是技术倒逼生态开放的经典案例。

一、到底发生了什么?

TinyCorp 团队(tinygrad 框架开发者)完成了一套面向 Apple Silicon 的用户态 GPU 驱动。核心突破:

| 维度 | 内容 |

|---|---|

| 连接方式 | Thunderbolt 4 / USB4(原生 PCIe 通道) |

| 支持显卡 | NVIDIA RTX 30/40/50、AMD RDNA 2/3/4 |

| 驱动形式 | 用户态驱动,无需关闭 SIP |

| 使用场景 | AI/ML 计算(tinygrad 框架) |

| 限制 | 不支持图形加速、游戏、外接显示器 |

简单说——它让你的 Mac 多了一块专用 AI 算力 GPU。 不是替代内置 GPU,是给它加一块”外挂引擎”。

二、怎么接?五分钟搞定

硬件清单:

| 硬件 | 推荐方案 |

|---|---|

| Mac | 任何 M1/M2/M3/M4/M5 芯片 Mac |

| 显卡 | NVIDIA RTX 4090 / AMD RX 7900 XT |

| 转接器 | ADT-UT3G(TB 转 PCIe x16) |

| 供电 | 显卡独立电源(ATX 或 eGPU 坞站) |

软件三步走:

pip install tinygrad

python -c "from tinygrad import Device; print(Device.DEFAULT)"

python -c "from tinygrad import Tensor; print(Tensor.ones(4,4).realize())"

接线→安装→运行,五分钟搞定。 连配置文件都不用改。

五年前想在 Mac 上用外接显卡,只能 Bootcamp 装 Windows。今天,一条 pip install 就够了。时代变了。

三、接上之后能干什么?

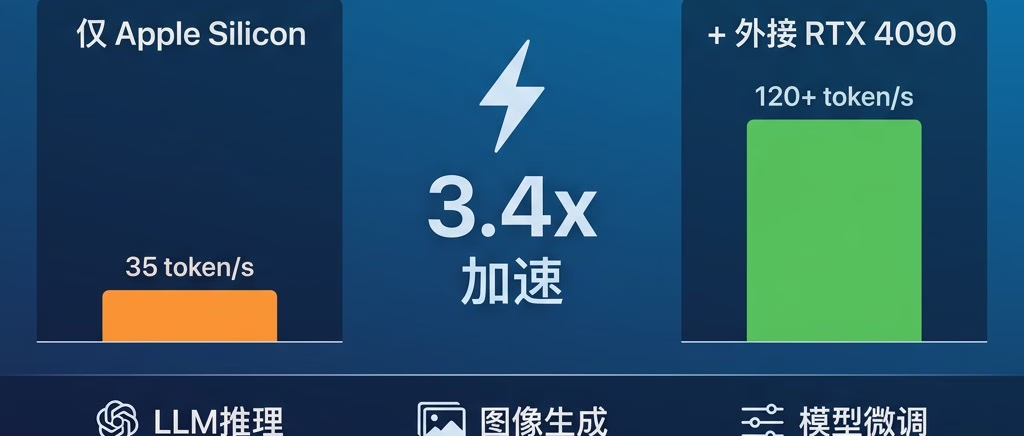

Mac 内存够大,但推理速度受内置 GPU 限制。外接 RTX 4090 之后:

| 场景 | 仅 Apple Silicon | + 外接 RTX 4090 |

|---|---|---|

| LLM 推理(7B) | 35 token/s | 120+ token/s |

| 图像生成(SDXL) | 45 秒/张 | 8 秒/张 |

| 模型微调 | 不实用 | 可用 |

核心价值:Mac 负责内存和编排,外接 GPU 负责暴力计算。 两者各取所长。

我的方案是 Mac Studio M3 Ultra 256GB + 外接 RTX 4090。Mac 把千亿参数模型加载到统一内存,推理交给 4090。内存归苹果,算力归英伟达——这才是最优解。

Mac 的内存优势 + NVIDIA 的算力优势,终于不再互斥。一台设备同时拥有两个生态的顶级能力,半年前不可想象。

四、为什么现在才成?

苹果 2020 年转向 Apple Silicon 时,直接砍掉了 eGPU 支持。态度很明确:统一内存不需要外接 GPU。

但 AI 时代打了苹果的脸:

| 苹果的预判 | 现实 |

|---|---|

| 内置 GPU 够用 | AI 推理需要海量并行算力 |

| 统一内存解决一切 | 内存够大但计算不够快 |

| 用户不需要 eGPU | 开发者用脚投票 |

TinyCorp 的做法很聪明——在用户态实现 GPU 驱动,绕过内核。 不碰 macOS 安全机制,苹果没有理由也没有动力封杀。

苹果不是"批准"了驱动——而是社区找到了苹果无法拒绝的路。用户态不触碰内核,封不了,也不想封。技术倒逼生态开放,这才是真正的破局。

写在最后

Mac 外接显卡这件事,等了整整五年。从 Intel 时代的 eGPU 被砍,到 Apple Silicon 的完全封锁,再到今天社区驱动突破——Mac 用户终于不用在「生态」和「算力」之间二选一了。

我一个人打造的 Zaokit AI 正在内测,前 1000 名用户赠送价值 150 RMB 的 Pro 计划,助力大家高效完成图文创作和 PPT 生成,唯一网站:zaokit.app。

AI 时代的算力格局正在被重写。Mac 不再是孤岛——一根 Thunderbolt 线,就能连接整个 GPU 生态。苹果没说行,但也没说不行。这就够了。

相关阅读

Mac 与 AI 算力系列