昨天我写了《OpenClaw之父的AI Agent实战手册》,讲的是Peter Steinberger的方法论。

今天讲的是:当我真正上手用的时候,发生了什么。

最近几天,一款叫OpenClaw的AI工具在技术圈彻底火了。

它的前身叫Moltbot(也叫Clawdbot),由知名开发者Peter Steinberger打造。简单来说,它是一个能自己动手干活的AI助手——不只是聊天,而是能真正帮你读文件、写代码、甚至生成图片。

听起来很美好对吧?我也这么想,所以第一时间就装上试了试。

结果嘛……一言难尽。

先说结论:能用,但需要折腾

如果你问我”现在值不值得装”,我的答案是:

- 技术爱好者、喜欢折腾的人:值得一试,但要做好心理准备

- 普通用户、想开箱即用的人:建议再等等,目前坑太多

为什么这么说?让我用最通俗的方式,讲讲这几天我踩过的坑。

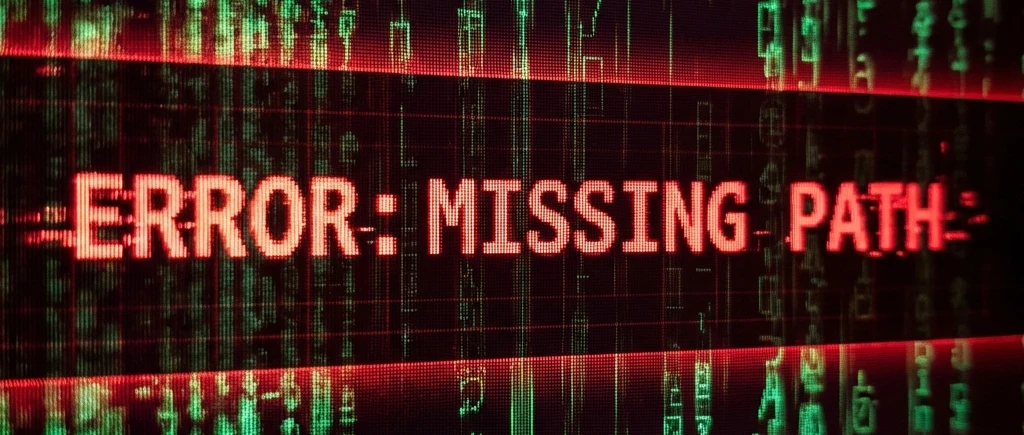

第一个大坑:AI工具调用频繁失败

这是最让人崩溃的问题。

OpenClaw最核心的能力是什么?是让AI能够调用各种工具——读文件、写代码、执行命令、生成图片。没有这些工具,AI就只是一个聊天机器人。

但在最近的版本里,工具调用会莫名其妙地失败。

实际报错画面:这个红色的Error信息,这两天我看了不下几十次

实际报错画面:这个红色的Error信息,这两天我看了不下几十次

想象一下这个场景:

你请了一个超级厉害的助手来帮你整理房间。你把钥匙给他,告诉他”柜子在卧室里”。结果他站在卧室门口,对着空气喊:”我找不到柜子在哪!”

你再告诉他一遍,他还是说找不到。

你换个说法,”卧室里的那个大柜子”,他说:”什么是卧室?”

这就是我这两天的真实体验。

具体表现是:

- AI明明给出了正确的指令,但工具层就是不执行

- 同样的操作,有时候成功有时候失败,完全随机

- 报错信息含糊不清,根本不知道哪里出了问题

后果很严重:AI连你的文件都看不了,后面所有操作都没法进行。这就像请了个装修工人,结果他连门都进不去。

第二个大坑:本地图片生成完全跑不通

OpenClaw有一个很酷的功能:可以让AI帮你生成图片。

比如你在写文章,需要一张配图,直接跟它说”帮我画一张XXX的图”,理论上它就能搞定。

但当你想用本地模型时,问题就来了。

什么是本地模型?简单说就是在你自己电脑上运行的AI,不用联网,不用付费,数据也不会传到云端。对于在意隐私和成本的人来说,这是刚需。

我尝试用本地的图片生成服务(通过代理转发的Gemini Image模型)来生成配图。

结果:请求发出去了,石沉大海。

OpenClaw收到返回的数据后,直接懵了——它只认识一种”图片格式”,就像一个只会吃米饭的人,你给他面条,他就不知道怎么办了。

本地模型返回的图片格式,恰好就是它不认识的那种。

我是怎么解决的?

说实话,这两个问题折腾了我整整一天。

一开始我以为是自己配置有问题,反复检查了好几遍。后来在GitHub Issues里搜了搜,发现不少人遇到了类似的情况——这是软件本身的Bug。

但官方的修复还没有合入主分支。等?不知道要等多久。

于是我决定自己动手。

修复过程:在源码里找问题、打补丁

修复过程:在源码里找问题、打补丁

花了大半天时间,我把OpenClaw的源码扒了一遍,终于找到了问题所在:

问题一的根源:工具调用层的参数校验写得太死板。AI模型(尤其是Claude和Gemini这种聪明的)会根据上下文选择不同的参数名,但OpenClaw只认一种写法。只要AI换个说法,它就”听不懂”了。

问题二的根源:图片处理逻辑只考虑了云端API的返回格式,完全没适配本地模型。本地模型返回的Base64数据,OpenClaw根本不知道怎么处理。

找到问题之后,修复思路其实不复杂:

- 工具调用问题:让OpenClaw能听懂多种”方言”,不管AI怎么说,它都能理解

- 图片生成问题:增加对Base64格式的支持,让它学会处理本地模型的返回数据

修复之后,效果立竿见影——终于能正常工作了:

修复后成功生成的图片——这张图就是用本地模型生成的

修复后成功生成的图片——这张图就是用本地模型生成的

这说明什么问题?

OpenClaw的遭遇,其实反映了当前很多”爆火”开源AI项目的通病:

1. 理想很丰满,现实很骨感

OpenClaw的设计理念确实很先进,Peter Steinberger的架构思路也很漂亮。但从”设计图”到”能住人的房子”,中间还有大量的工程工作要做。

目前它更像是一个”毛坯房”——框架在那儿,核心功能也有了,但细节问题一大堆。

2. “爆火”不等于”好用”

社交媒体上的热度,往往来自那些最先尝鲜的技术大牛。他们有能力自己解决问题,所以体验会比普通用户好很多。

但当普通用户跟风安装时,才会发现”怎么跟说的不一样”。

10万Star不代表开箱即用,尤其对于这种快速迭代的开源项目。

3. 开源软件的双刃剑

好处是:遇到问题,你可以自己动手修。

坏处是:如果你不会修,那就只能干等官方更新。

我花了一天时间修Bug,普通用户可能连问题出在哪都定位不了。

给不同读者的建议

如果你是技术人员:

- 可以尝试,但建议先看看GitHub上的Issues列表,了解目前有哪些已知问题

- 做好自己动手修Bug的心理准备——这不是开箱即用的成熟产品

- 我已经把修复方案整理好了,准备提交给官方,有兴趣可以关注后续

如果你是普通用户:

- 建议等1-2个月,让社区把主要Bug修完

- 或者等官方出一个更稳定的版本

- 如果实在想尝鲜,记住:遇到问题不是你的错,是软件还不够成熟

写在最后

我并不是想劝退大家。恰恰相反,我对OpenClaw的未来非常看好。

它代表了AI工具的一个重要方向:不只是聊天,而是真正能帮你干活。这个方向绝对是对的。Peter在访谈里说的那些理念——验证闭环、并行调度、Prompt驱动——都是真知灼见。

只是目前,工具本身还需要时间来打磨。就像一款新车,性能参数很亮眼,但需要经过大量路测才能真正上市。

现在的OpenClaw,就是在”路测”阶段。我们这些早期用户,其实就是在帮它测试。

踩坑虽然烦,但看着问题一个个被解决,这种参与感也挺有意思的。

毕竟,能见证一款可能改变未来的工具从”毛坯”变成”精装”,本身就是一种独特的体验。

Agentic Engineering的时代,修Bug也是一种修行。

相关阅读

OpenClaw/Moltbot 系列

- OpenClaw之父的AI Agent实战手册 - Peter Steinberger 114分钟访谈精华

- Clawdbot刷屏AI圈,我为什么劝你别急着用 - 安全风险深度分析

AI Agent 系列

- 通用AGI工具已经到来 - Claude Code 深度分析

- 你觉得AI不行?也许是你的’使用姿势’还停在2023年 - AI 使用姿势演进

注:本文配图由修复后的OpenClaw通过本地Image生成模型创作。